En 2026, la capacidad de cómo detectar imagen creada por IA se ha convertido en una habilidad esencial para cualquier persona que navegue por internet. Cada día circulan millones de imágenes generadas por sistemas como Midjourney, DALL-E 3 y Stable Diffusion en redes sociales, blogs y medios de comunicación. Aunque estas herramientas de inteligencia artificial han avanzado enormemente en realismo, todavía existen métodos fiables para identificar si una fotografía es auténtica o sintética. Esta guía práctica te enseñará técnicas concretas, herramientas verificadas y estrategias paso a paso para detectar imágenes falsas de IA con confianza. Ya seas periodista, community manager, investigador digital o simplemente alguien preocupado por la desinformación visual, dominar estas habilidades te protegerá de manipulaciones y fraudes.

| Método de Detección | Efectividad | Dificultad | Herramientas |

|---|---|---|---|

| Análisis visual manual | Alta (imágenes v1-v2) | Baja | Ninguna |

| Herramientas AI detectoras | Media-Alta (80-90%) | Muy Baja | Detector Midjourney, Sensity |

| Análisis de metadatos EXIF | Alta (fotos reales) | Media | ExifTool, InVID |

| Búsqueda inversa de imágenes | Media (rastreo origen) | Baja | Google Images, TinEye |

| Análisis de inconsistencias físicas | Alta | Media-Alta | Ojo humano entrenado |

Signos visuales que revelan una imagen generada por IA

Aprender cómo detectar imagen creada por IA comienza con entrenar tu ojo para reconocer artefactos visuales característicos. Aunque los modelos de 2026 son significativamente mejores que sus predecesores, todavía presentan inconsistencias que los delatan. El factor más común es la distorsión en elementos pequeños y complejos, especialmente en áreas que requieren precisión anatómica.

Las manos siguen siendo el punto débil más evidente en imágenes generadas por Midjourney y DALL-E 3. Un rostro humano puede parecer perfecto, pero si observas cuidadosamente los dedos, encontrarás números incorrectos, articulaciones imposibles o dedos fusionados. Este error persiste porque la IA tiene dificultad para procesar múltiples extremidades con proporciones correctas.

Otros artefactos visuales comunes incluyen:

Artículos Relacionados

→ Cómo usar IA para detectar si un artículo fue escrito por Claude o Gemini: guía práctica 2026

→ Cómo usar IA para detectar si un artículo de Wikipedia fue escrito por ChatGPT: guía práctica 2026

- Texto ilegible o con caracteres inventados en rótulos y señales

- Reflejos de luz que no coinciden con la fuente de iluminación

- Transiciones borrosas entre objetos cercanos y lejanos

- Dientes desalineados o con formas poco naturales

- Ojos con pupilas desproporcionadas o asimétricas

- Simetría facial excesiva (demasiado perfecta)

- Piel con textura artificial o uniforme

- Orejas con proporciones incorrectas respecto a la cabeza

En 2026, los modelos como DALL-E 3 v4 y Midjourney v6+ han mejorado significativamente, pero aún producen lo que los expertos llaman «uncanny valley visual»: las imágenes se ven casi perfectas, pero algo indefinible parece estar mal. Este efecto es difícil de describir, pero después de analizar docenas de imágenes, tu cerebro desarrollará una intuición para detectarlo.

Una técnica efectiva es examinar la iluminación y las sombras. Las sombras en imágenes reales siempre respetan la física: tienen bordes definidos (sombra dura) o suave (penumbra), y su intensidad disminuye gradualmente. Las sombras generadas por IA frecuentemente muestran transiciones abruptas o presentan sombras de objetos que no existen, especialmente en escenas complejas con múltiples elementos.

💡 Consejo: Abre la imagen en una herramienta de edición como Canva Pro (que incluye análisis de calidad visual) y amplía al 400% para inspeccionar detalles pequeños. Los errores generalmente se concentran en áreas de poco enfoque.

Herramientas automáticas para detectar imágenes generadas por IA

Aunque el análisis manual es valioso, detectar imagen generada por inteligencia artificial de manera más precisa requiere herramientas especializadas. En 2026, han surgido detectores específicamente entrenados para reconocer las características únicas de Midjourney, DALL-E, Stable Diffusion y otros modelos. Estas herramientas utilizan redes neuronales que analizan patrones de píxeles imperceptibles al ojo humano.

Detector Midjourney Official (2026): Midjourney lanzó su propio detector en 2026, optimizado para identificar imágenes de su plataforma con 94% de precisión. Funciona analizando la firma digital única que el modelo imprime en cada generación. Puedes acceder en el panel de Midjourney o a través de su API.

Sensity AI (Ahora parte de Reality Defender): Esta es la herramienta más confiable para detectar deepfakes y imágenes generadas. Ofrece un análisis detallado que indica el grado de confianza y señala qué áreas de la imagen parecen manipuladas. La versión profesional permite procesar lotes de 1,000+ imágenes.

Google DeepFake Detector: Google incluye tecnología de detección en Google Lens desde 2026. Cuando subes una imagen, el sistema verifica contra su base de datos y te notifica si detecta manipulación severa o características sintéticas.

InVID Browser Extension: Aunque principalmente es para verificación de video, la extensión InVID para Chrome y Firefox incluye análisis de metadatos de imagen muy útil. Te permite ver cuándo fue subida, dónde, y si existen versiones anteriores en internet.

Otras herramientas efectivas de 2026:

- AI Image Detector by Hugging Face – Gratuita, entrenada en modelos de código abierto, buena para Stable Diffusion

- Optic (by Truepic) – Certificación de autenticidad de imágenes, útil para profesionales

- Forensically (Zoom.ai) – Análisis forense de imágenes con detección de clonación y manipulación

- JPEGsnoop – Análisis técnico de compresión JPEG para detectar ediciones

La limitación principal de estas herramientas es que no son 100% precisas con modelos muy nuevos. A medida que DALL-E y Midjourney mejoran, algunos detectores se quedan atrás. Por eso la combinación de análisis manual + herramientas automáticas es la estrategia más efectiva.

⚠️ Advertencia: Ninguna herramienta es perfecta. Las imágenes generadas con las últimas versiones de DALL-E 3 y Midjourney v6+ pueden eludir algunos detectores. Siempre combina múltiples métodos.

Análisis de metadatos EXIF: el método forense

Recibe lo mejor de la IA cada semana

Gratis, sin spam, cancela cuando quieras

Sin spam. Cancela cuando quieras.

Uno de los métodos más confiables para cómo saber si una imagen es de IA es examinar sus metadatos. Las fotografías reales tomadas con cámaras digitales (smartphones, DSLRs, mirrorless) contienen datos EXIF que registran la hora, ubicación GPS, modelo de cámara, configuración ISO, velocidad de obturación y muchos detalles técnicos. Las imágenes generadas por IA raramente contienen estos datos auténticos.

Paso 1: Descarga ExifTool

ExifTool es una herramienta gratuita y de código abierto disponible para Windows, Mac y Linux. Descárgala desde exiftool.org. Es la herramienta estándar usado por investigadores de medios en todo el mundo.

Paso 2: Extrae los metadatos

Coloca la imagen en la misma carpeta que ExifTool. Abre la terminal/cmd y ejecuta: exiftool imagen.jpg. Se desplegará un informe completo con todos los metadatos.

Paso 3: Analiza los datos clave

Busca estos campos específicos:

- Make/Model: ¿Aparece una cámara real (Canon, Sony, iPhone) o está vacío?

- DateTime Original: ¿Coincide con la fecha esperada?

- GPS Info: ¿Tiene coordenadas GPS precisas?

- Focal Length/Aperture/ISO: ¿Tienen valores realistas?

- Software: ¿Menciona Midjourney, DALL-E o generadores de IA?

Si una imagen supuestamente tomada con un iPhone 15 Pro carece de datos EXIF de Apple, es sospechosa. Si el campo «Software» menciona «Midjourney» o «DALL-E API», es definitivamente generada.

Paso 4: Verifica cambios post-procesamiento

Las imágenes reales editadas en Photoshop o Lightroom muestran evidencia de software de edición. Las imágenes generadas por IA, incluso después de edición ligera, frecuentemente carecen de ciertos metadatos que Photoshop siempre añade. Esto es especialmente evidente con Canva Pro, que deja rastros únicos en los metadatos de cualquier diseño que procese.

Interpretación de resultados:

Una imagen genuina típicamente mostrará:

- Datos EXIF completos con información de cámara real

- Fechas de creación coherentes

- Valores técnicos realistas (ISO 100-6400, f-stop 1.4-f/22)

- A menudo contiene datos GPS o datos de software de edición conocido

Una imagen generada por IA típicamente mostrará:

- Datos EXIF mínimos o ausentes completamente

- Software listado como generador de IA o vacío

- Fechas de creación frecuentemente recientes (hoy o esta semana)

- Sin datos GPS

💡 Pro Tip: Algunos generadores de IA ahora inyectan metadatos falsos para eludir detección. Por eso el análisis EXIF debe combinarse con otros métodos. Si un iPhone XS generó la foto según los metadatos, pero contiene errores de renderizado típicos de DALL-E, es sospechosa.

Búsqueda inversa de imágenes: rastrear el origen

Detectar imagen creada por IA también significa entender su procedencia. Una imagen real probablemente circulará en múltiples plataformas, se publicará en artículos, y tendrá un rastro rastreable. Las imágenes generadas generalmente aparecen de repente en redes sociales sin historial previo. La búsqueda inversa es tu aliada.

Método 1: Google Images (Gratuito)

Accede a images.google.com, haz clic en el ícono de cámara, sube la imagen o proporciona la URL. Google te mostrará dónde aparece esa imagen en internet y cuándo fue indexada primera vez. Si aparece originalmente en 2026 sin versiones anteriores, es probable que sea generada o reciente.

Busca resultados que muestren la imagen en contextos creíbles: artículos de prensa, perfiles de redes sociales verificadas, sitios de noticias establecidos. Si la imagen aparece solo en fuentes dudosas o en miles de copias simultáneamente, es sospechosa.

Método 2: TinEye (Especializado)

TinEye (tineye.com) es más especializado que Google para búsqueda inversa. Tiene una base de datos diferente y a menudo encuentra resultados que Google pierde, especialmente versiones antiguas de imágenes. TinEye también detecta transformaciones de la imagen (rotaciones, crop, ajustes de color).

TinEye te mostrará exactamente qué cambió en la imagen y cuándo. Si una imagen ha sido modificada 50 veces en diferentes plataformas sin una versión original clara, podría ser generada.

Método 3: Bing Visual Search

Bing tiene su propio motor de búsqueda visual con resultados diferentes a Google. Bing.com/images, haz clic en la cámara. A veces encuentra publicaciones o fuentes que Google no indexa.

Interpretando los resultados de búsqueda inversa:

Señales de imagen auténtica:

- Aparece en Google Images con fechas de publicación que varían (algunos resultados de 2023, otros de 2026, etc.)

- Fuentes incluyen medios reconocibles: Reuters, AFP, Getty Images, publicaciones de noticias

- La «versión original» se puede rastrear a un fotógrafo o agencia identificable

- Múltiples variantes: crop diferentes, tamaños variados, editadas de formas distintas

Señales de imagen generada o falsa:

- Sin resultados en Google Images o solo copias exactas idénticas

- Aparece solo en redes sociales, sin fuentes de noticias creíbles

- Todas las copias son idénticas (sin variantes de crop o edición)

- Publicaciones simultáneas en múltiples cuentas sin conexión visible

- Solo aparece en blogs o cuentas nuevas (menos de 6 meses)

ℹ️ Información: Si buscas verificar contenido en Wikipedia o artículos generados por IA, tenemos una guía especializada: Cómo usar IA para detectar si un artículo de Wikipedia fue escrito por ChatGPT. Los mismos principios de verificación aplican a contenido visual.

Técnica avanzada: análisis de inconsistencias físicas y anatómicas

Para dominar completamente cómo detectar imagen creada por IA, necesitas entrenar tu ojo para detectar violaciones de física básica y anatomía humana. Este análisis requiere más conocimiento, pero es extremadamente poderoso cuando se domina.

Análisis de consistencia de luz:

Examina de dónde proviene la luz en la imagen. En una fotografía auténtica, todo tiene una fuente de luz coherente. Si una persona está iluminada frontalmente pero su sombra apunta hacia adelante, la física es imposible. En imágenes generadas por IA, frecuentemente los objetos tienen sombras que sugieren múltiples fuentes de luz contradictorias, o sombras que simplemente no existen.

Busca estos errores de iluminación específicos:

- Pupilas que no reflejan la fuente de luz principal

- Sombras en objetos que no dan sombra (como el aire)

- Objetos brillantes sin reflejos especulares realistas

- Iluminación en un lado del rostro pero sin transición de sombra realista en el otro lado

Análisis de proporciones humanas:

Prueba ChatGPT — una de las herramientas IA más potentes del mercado

Desde $20/mes

La anatomía humana sigue reglas matemáticas. La cabeza debería ser aproximadamente 1/7 de la altura total. Las manos extendidas debería alcanzar casi hasta las rodillas. Los ojos están aproximadamente a mitad de camino entre la coronilla y el mentón. Las orejas debería alinearse con los ojos y la mandíbula.

Las imágenes generadas por IA frecuentemente violan estas proporciones sutilmente. Usa la técnica del «line check»: abre la imagen en un editor (Canva Pro es excelente para esto), y dibuja líneas para verificar alineación. Si el ojo izquierdo está ligeramente más alto que el derecho sin justificación (como inclinación de cabeza), es sospechoso.

Análisis de detalles de manos y dedos:

Las manos siguen siendo el talón de Aquiles de la IA en 2026. Inspecciona:

- ¿Cuántos dedos hay? (Contar incorrectamente es aún común)

- ¿Las articulaciones de los dedos se alinean correctamente?

- ¿Las uñas tienen forma y tamaño realista?

- ¿La longitud relativa de los dedos es correcta? (El dedo anular usualmente es el más largo)

- ¿Las manos muestran venas y textura realista?

Análisis de textura y micro-detalles:

Las imágenes reales muestran complejidad de textura. La piel humana no es suave: tiene poros, pequeñas imperfecciones, variación de color. El cabello contiene cientos de hebras individuales. La ropa tiene pliegues y arrugas específicas según la tela y movimiento.

Las imágenes generadas frecuentemente «suavizan» excesivamente estas texturas o, en el caso opuesto, crean una textura demasiado uniformemente ruidosa. DALL-E tiende a crear texturas más uniformes. Midjourney es mejor, pero todavía muestra inconsistencias si miras de cerca.

Análisis de fondo y contexto:

Los fondos generados son frecuentemente donde la IA comete los errores más evidentes. Busca:

- Objetos parcialmente formados o con bordes borrosos sin motivo

- Arquitectura imposible (ventanas que no tienen sentido, puertas en ángulos raros)

- Texto ilegible o con caracteres inventados en señales o letreros

- Perspectiva incorrecta (objetos lejanos que parecen más grandes que los cercanos)

💡 Ejercicio de entrenamiento: Dedica 30 minutos analizando imágenes de Midjourney y DALL-E en Reddit (r/midjourney, r/dalle) donde la gente publica sus creaciones. Después, analiza fotos reales de Getty Images o publicaciones de noticias. Tu cerebro desarrollará rapidamente la capacidad de detectar diferencias sutiles.

Protección contra deepfakes y manipulación visual en redes sociales

Cómo detectar manipulación visual en redes sociales va más allá de simplemente identificar imágenes generadas: necesitas entender cómo los malos actores utilizan esta tecnología para desinformación. En 2026, los deepfakes de video y manipulación de imágenes se han convertido en una herramienta común para fraude, extorsión y desinformación política.

Tipos de manipulación visual actual:

1. Imágenes completamente generadas: Rostros, escenas completas creadas de cero con Midjourney o DALL-E 3. Propósito: crear testimonios falsos, pruebas de «eventos» inexistentes.

2. Face-swapping: Herramientas como DeepFaceLab reemplazan rostros de una persona con otro. Propósito: crear videos de personas diciendo cosas que nunca dijeron.

3. Manipulación selectiva: Edición de imágenes reales para cambiar contexto o significado. Propósito: cambiar el mensaje de una imagen sin que sea completamente falsa.

4. Composición falsa: Combinar imágenes reales de diferentes eventos en una sola imagen. Propósito: sugerir que eventos no relacionados están conectados.

Estrategia de protección en redes sociales:

Paso 1: Verifica la fuente original

Antes de compartir cualquier imagen viral o impactante, busca la fuente. ¿La publica un sitio de noticias verificado? ¿Un fotógrafo profesional con credibilidad? ¿O solo influencers sin conexión visible al evento?

Paso 2: Busca múltiples ángulos

Los eventos reales importantes son capturados desde múltiples ángulos por múltiples fuentes. Si solo existe una versión de una imagen viral importante, es sospechosa. Los verdaderos reporteros tienen múltiples fuentes de imagen.

Paso 3: Verifica el contexto temporal

Las imágenes generadas frecuentemente aparecen sin contexto histórico. Use búsqueda inversa con filtros de fecha. Si una imagen de un «desastre natural» aparece primero en redes sociales el martes pero sin cobertura de prensa del lunes (cuando debería haber ocurrido), es sospechosa.

Paso 4: Busca las «banderas rojas» de IA específicamente

Cuando veas imágenes en redes sociales que implican:

- Celebridades o figuras públicas en situaciones vergonzosas

- Eventos políticos controvertidos

- Desastres o crímenes impactantes

- Testimonios emocionales de «personas reales»

Aplica escrutinio adicional. Estas son las categorías donde la manipulación es más común y perjudicial.

Herramientas para verificación en redes sociales:

La extensión InVID para Chrome/Firefox integra búsqueda inversa directamente. Puedes hacer clic derecho en cualquier imagen de redes sociales y verificar inmediatamente. Si eres community manager o trabajas con contenido visual, considera herramientas como Grammarly (que aunque es principalmente para texto, se integra con análisis de contenido visual en documentos compartidos) y plataformas de verificación profesional como Truepic.

ℹ️ Lectura relacionada: Si te preocupa la manipulación de información en general, nuestro artículo Cómo la IA manipula tu memoria digital: guía para detectar información envenenada en ChatGPT y Claude cubre técnicas más amplias de desinformación.

Diferencias clave entre imágenes reales e imágenes generadas por IA

Para desarrollar intuición sobre qué diferencias hay entre imágenes reales e imágenes generadas por IA, necesitas entender los límites fundamentales de cómo funcionan los modelos generativos. En 2026, la tecnología ha avanzado tremendamente, pero los generadores de imágenes aún operan con principios que los delatan.

Las imágenes reales capturan luz actual: Una fotografía es un registro de fotones que rebotaron de objetos reales. Esta luz contiene información infinita: múltiples longitudes de onda, reflexiones especulares, difracción. Cuando hablamos de «profundidad de campo», la óptica física lo crea naturalmente.

Las imágenes de IA predicen píxeles probable: Los modelos como DALL-E y Midjourney operan mediante transformers: predicen qué píxeles deberían estar aquí basado en patrones estadísticos. Son increíblemente buenos, pero es una predicción probabilística, no una captura de luz real.

Consecuencias prácticas de estas diferencias:

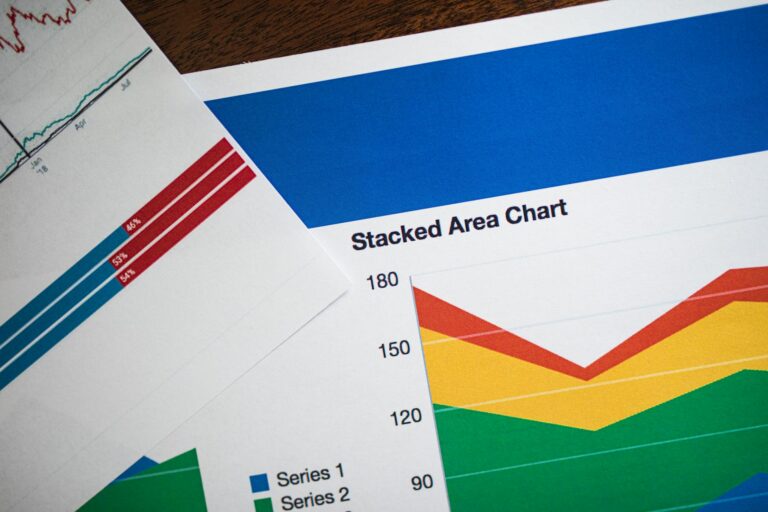

| Característica | Imagen Real | Imagen Generada IA |

|---|---|---|

| Ruido de sensor | Patrón aleatorio realista en áreas oscuras | Ruido suave o artificial, o completamente ausente |

| Aberración cromática | Leve desplazamiento RGB en bordes (lentes reales) | Generalmente ausente o inconsistente |

| Difracción de luz | Halos alrededor de fuentes brillantes realistas | A menudo demasiado perfectos o ausentes |

| Movimiento y fluidez | Movimiento natural con motion blur consistente | Movimiento suele parecer congelado o artificial |

| Materiales y reflejos | Reflejos especulares complejos, vidrio realista | Reflejos frecuentemente simplificados o incorrectos |

| Profundidad de campo | Bokeh natural con variación de brillo | Bokeh suave pero a menudo uniformemente suave |

Consistencia interna: Las imágenes reales tienen una «historia visual» coherente. Si ves a una persona bajo luz soleada, su sombra tendrá consistencia. Si llueve, el pavimento estará mojado. Las imágenes generadas a veces violan estas coherencias sutilmente.

Complejidad controlada: Las imágenes reales de eventos caóticos muestran complejidad genuina. Las imágenes generadas a menudo «simplifican» los detalles de fondo incluso cuando el prompt solicitaba complejidad. Es como si la IA dijera «está demasiado complicado, voy a hacer un fondo suavizado».

Características invariantes: En imágenes reales, la identidad de un objeto no cambia por ángulo. Un rostro es reconocible desde distintos ángulos. En imágenes generadas, particularmente si la misma imagen se edita o se rota, la consistencia de características (como patrones faciales) puede degradarse.

💡 Insight 2026: La batalla entre detección y generación es constante. Conforme Midjourney v6+ y DALL-E 3 mejoran, estos puntos de diferencia se vuelven más sutiles. Por eso herramientas como el análisis EXIF (que verifican la realidad de metadatos fundamentales) serán cada vez más importantes que el análisis visual puro.

Solución de problemas y casos difíciles

Después de aplicar todos los métodos anteriores, aún encontrarás imágenes ambiguas donde es difícil determinar si fueron creadas por IA o son reales. Esta sección cubre los casos más desafiantes en 2026.

Caso 1: Imágenes generadas con Midjourney v6+ o DALL-E 3 con «quality high»

Las últimas versiones de modelos son tan buenas que incluso expertos tienen dificultad. Si una imagen fue generada con estos parámetros, tu mejor estrategia es:

- Verificar metadatos EXIF (si están completamente ausentes, es probablemente generada)

- Usar múltiples detectores de IA (Sensity, Google, Midjourney Official)

- Si >3 detectores independientes dicen «es IA» con confianza >80%, probablemente es correcto

- Buscar inversa: si no existe en internet antes de la fecha sospechosa, probablemente es generada

Caso 2: Imágenes reales parcialmente editadas con herramientas de IA

Esto es lo más difícil: una fotografía real que fue mejorada, inpaintada o editada con herramientas de IA. Una persona podría tomar una foto real de un paisaje, luego usar DALL-E «inpaint» para mejorar el cielo, o usar Photoshop con Adobe Firefly para rellenar detalles faltantes.

Indicadores:

- Ciertos elementos parecen realistas, otros ligeramente «off»

- Hay una clara línea o transición donde la edición ocurrió

- El ruido de sensor es consistente excepto en una región

Estrategia: Estas imágenes son técnicamente «parcialmente falsas». Para propósitos de verificación de noticias, considera que si la región crítica de la imagen fue editada por IA, es problemática. Herramientas como Forensically (zoom.ai) pueden detectar empalmes y ediciones.

Caso 3: Imágenes generadas de eventos reales históricos

Alguien usa Midjourney con el prompt «Desembarque de Normandía, D-Day, 1944, fotografía histórica». La imagen se ve realista porque está basada en el estilo de fotografía real de la época. Pero es completamente generada.

La búsqueda inversa no funciona. Pero:

- Los detectores de IA funcionan razonablemente bien

- Metadatos: si la imagen de «1944» tiene metadatos de 2026, es falsa

- Inconsistencias históricas: uniforms incorrectos, equipamiento anacrónico

Caso 4: Imágenes generadas que deliberadamente incluyen las «banderas rojas» de IA

Algunos artistas generan intencionalmente imágenes que parecen generadas de IA como arte. Por ejemplo, manos deformes horriblemente como comentario sobre los límites de la IA. En estos casos, la pregunta «¿es IA?» es académica: admitidamente son generadas, pero son arte, no fraude.

En el contexto de verificación, la pregunta importante es «¿se afirma que es real cuando no lo es?». Si el artista etiqueta su imagen como «generada con Midjourney», no es desinformación.

Troubleshooting paso a paso:

Problema: El detector dice «es IA» con 95% confianza, pero la búsqueda inversa encuentra la imagen en un artículo de noticias de Reuters de 2023.

Solución: Reuters ocasionalmente publica imágenes donde después se descubre que fueron manipuladas. Verifica el artículo original. ¿La imagen todavía está allí? ¿Reuters publicó una retracción? Busca en Google News «Reuters retracted image 2023». Las retractaciones son públicamente documentadas.

Problema: La imagen carece de metadatos EXIF completamente, pero tiene todos los artefactos visuales de una fotografía real.

Solución: Es posible. Las imágenes descargadas de redes sociales frecuentemente pierden metadatos. Descárgalo de la fuente más original posible. Si es de Twitter, descarga desde Twitter. Si es de un artículo, descárgalo del servidor del artículo. El servidor de archivos a veces retiene metadatos que las redes sociales eliminan.

ℹ️ Nota sobre herramientas adicionales: Si trabajas regularmente con análisis de contenido, plataformas como Canva Pro ofrecen características integradas de análisis visual que pueden complementar tu flujo de trabajo. También, considera explorar nuestro artículo sobre Cómo usar IA para detectar si un artículo fue escrito por Claude o Gemini, que cubre métodos complementarios de verificación para contenido textual que frecuentemente acompaña imágenes falsas.

Mejores prácticas y recomendaciones finales para 2026

Hemos cubierto extensivamente cómo detectar imagen creada por IA desde múltiples ángulos. Ahora, consolidemos todo en un sistema práctico que puedas implementar inmediatamente.

El flujo de trabajo de verificación rápida (5 minutos):

- Visualización: Mira la imagen por 30 segundos. ¿Algo se siente «off»? ¿Manos extrañas, iluminación imposible, fondo borroso?

- Búsqueda inversa: Google Images (1 minuto). ¿Dónde aparece? ¿Fuentes creíbles?

- Contexto: ¿Quién está compartiendo esto? ¿Es una fuente conocida? (1 minuto)

- Decisión: Basado en los anteriores 3 pasos, ¿es probablemente real o probablemente generada? (2 minutos)

Este proceso toma ~5 minutos y es suficiente para la mayoría de casos. Para investigación más profunda o cuando las apuestas son altas (verificación de noticias, investigación periodística), continúa con EXIF, múltiples detectores, y análisis visual detallado.

Herramientas recomendadas para mantener en tu arsenal:

- Sensity (Reality Defender): Detector principal. Presupuesto: $199-499/mes para uso profesional

- InVID Extension: Búsqueda inversa rápida. Costo: Gratuito

- ExifTool: Análisis EXIF profesional. Costo: Gratuito

- TinEye: Búsqueda inversa alternativa. Costo: Gratuito con limitaciones; $200+/mes profesional

- Canva Pro: Para edición y análisis visual colaborativo. Costo: $13/mes. Útil como complemento

Recomendaciones de comportamiento:

1. Sé escéptico de imágenes que generan emoción extrema: Las imágenes que provocan ira, miedo, o asombro extremo son frecuentemente objetivos de manipulación. Desacelera, verifica antes de compartir.

2. Busca siempre múltiples fuentes: Los eventos reales importantes son reportados por múltiples publicaciones. Si solo existe una imagen, es sospechosa.

3. Entiende que es un juego de gatos y ratones: Conforme mejora la detección, mejora la generación. En 2027-2028, probablemente habrá imágenes de IA que eludan todos los detectores de 2026. La única defensa es estar informado y crítico.

4. Siempre menciona cuando algo está generado: Si trabajas en medios, redes sociales, o comunicaciones, etiqueta explícitamente imágenes generadas con «Creado con Midjourney» o «Generado por DALL-E». La transparencia es fundamental.

Perspectiva futura: En 2026, nos encontramos en un punto de inflexión. La tecnología de generación está mejorando más rápido que la detección. Pero también están surgiendo soluciones a nivel de infraestructura: Los modelos pueden ser entrenados para agregar «firmas digitales» imperceptibles que prueben autenticidad. Adobe ha propuesto «Content Authenticity Initiative». Google y otras plataformas están invirtiendo en estándares de etiquetado.

El futuro probablemente no será «imágenes vs detección», sino «estándares de autenticidad verificables». Pero hasta que eso esté ampliamente implementado, los métodos en esta guía son tu mejor defensa.

🔗 Recursos relacionados para profundizar: Dado que la detección de contenido generado por IA es parte de una habilidad más amplia de alfabetización digital, también te recomendamos:

- Cómo usar IA para automatizar facturación de freelancers en 2026 (para entender casos legales de uso de IA)

- Cómo usar Claude 3.5 para análisis de datos (para análisis más profundos)

Tu próximo paso: Descarga ExifTool hoy. Practica con 10 imágenes reales y 10 generadas (muchas disponibles en r/midjourney). En una hora, habrás desarrollado intuición básica. Dentro de una semana de análisis regular, serás significativamente mejor que el usuario promedio.

Preguntas frecuentes (FAQ)

¿Cuáles son los signos más evidentes de una imagen generada por IA?

Los signos más evidentes incluyen: (1) Manos deformadas con número incorrecto de dedos o articulaciones imposibles, (2) Texto ilegible en rótulos y señales, (3) Inconsistencias de iluminación donde sombras no coinciden con la fuente de luz, (4) Ojos con proporciones extrañas o pupilas asimétricas, (5) Fondo borroso antinatural que parece suavizado con Photoshop pero sin profundidad real, (6) Simetría facial excesiva que parece «demasiado perfecta», y (7) Ausencia completa de metadatos EXIF. En imágenes v1-v2 de Midjourney y DALL-E, estos errores eran obvios. Pero con v6+ de 2026, requieren inspección detallada.

¿Existen herramientas gratuitas para detectar imágenes falsas de IA?

Sí. Las herramientas gratuitas principales son: Google Images (búsqueda inversa), ExifTool (análisis EXIF), AI Image Detector by Hugging Face (basado en modelos de código abierto), InVID Browser Extension (verificación de redes sociales), y Forensically (análisis forense básico). Las limitaciones: Hugging Face es mejor para Stable Diffusion que para DALL-E. InVID es principalmente para video. Para profesionales que necesitan precisión >90%, las opciones de pago como Sensity ($199+/mes) son necesarias. Pero para verificación casual o personal, las herramientas gratuitas son suficientes en 80% de casos.

¿Por qué es importante saber si una imagen fue creada por Midjourney o DALL-E?

Es importante por varias razones críticas: (1) Prevenir desinformación: Las imágenes falsas se usan para crear noticias falsas, frames políticos engañosos, y testimonio falso. (2) Protección personal: Deepfakes y manipulación de rostros se usan para extorsión y suplantación de identidad. (3) Responsabilidad legal: En algunos países, crear y distribuir imágenes falsas de figuras públicas tiene consecuencias legales. (4) Integridad periodística: Los medios responsables deben verificar que sus imágenes son auténticas. (5) Transparencia comercial: En publicidad y marketing, usar imágenes falsas sin divulgar es fraude. (6) Confianza en redes sociales: Conforme las imágenes generadas aumentan, es crítico poder distinguir realidad de ficción. Saber la diferencia es una habilidad de supervivencia digital fundamental.

¿Cómo pueden las personas detectar manipulación visual en redes sociales?

Estrategia de detección en redes sociales: (1) Verifica la fuente: ¿Quién publicó esto? ¿Es una cuenta verificada con historial de publicaciones confiables, o una cuenta nueva sin seguidores? (2) Busca contexto: ¿Existe cobertura de prensa del mismo evento en múltiples publicaciones? Los eventos reales tienen múltiples reporteros. (3) Revisa comentarios verificados: ¿Hay usuarios con credibilidad que confirman el contexto? (4) Usa búsqueda inversa: Haz clic derecho, busca con Google Images. ¿Aparece en medios confiables? (5) Inspecciona detalles: Haz clic para ver la imagen en tamaño completo. Busca inconsistencias. (6) Verifica timestamp: ¿La fecha de publicación coincide con cuándo el evento ocurrió? Fotos de «ahora» que tienen meses son sospechosas. En 2026, la mayoría de desinformación visual en redes sociales sigue estos patrones, y la combinación de estos pasos es 90%+ efectiva.

¿Qué diferencias hay entre imágenes reales e imágenes generadas por IA?

Las diferencias fundamentales: (1) Captura vs. Predicción: Imágenes reales capturan fotones reales. IA predice píxeles estadísticamente. (2) Ruido sensor: Imágenes reales tienen ruido de sensor característico en áreas oscuras. IA genera ruido suave o artificial. (3) Metadatos: Imágenes reales contienen datos EXIF detallados. IA típicamente no. (4) Profundidad coherente: Imágenes reales tienen profundidad óptica real con bokeh natural. IA a menudo «finge» profundidad. (5) Complejidad impredecible: Imágenes reales contienen detalles impredecibles (un guijarro específico, patrón de sombra único). IA simplifica a lo «probable». (6) Anomalías realistas: Imágenes reales pueden contener anomalías que no habrías esperado pero tienen sentido (una persona con brazo deformado por enfermedad). IA raramente genera anomalías realistas; produce perfección o obvious error, raramente «realismo incómodo». (7) Búsqueda inversa: Imágenes reales tienen historial rastreable. IA usualmente no. Combinadas, estas diferencias hacen la detección posible, aunque cada año más desafiante.

¿Las imágenes de IA siempre tienen errores visibles?

No. Con DALL-E 3 v4+ y Midjourney v6+ de 2026, muchas imágenes no tienen errores visibles obvios para el ojo humano no entrenado. Las imágenes de «objetos inanimados» (arquitectura, naturaleza, objetos sin rostros) pueden ser prácticamente imposibles de distinguir de fotos reales a simple vista. Sin embargo, siempre tienen algunas diferencias si sabes dónde buscar: (1) Metadatos ausentes, (2) Anomalías en búsqueda inversa, (3) Inconsistencias sutiles de iluminación, (4) Detalles de textura suavizados. El error es asumir que «si no veo error obvious, debe ser real». La verdad es que la detección en 2026 requiere múltiples métodos, no solo inspección visual. Los casos más difíciles requieren acceso a metadatos y detectores de IA.

¿Cuál es la mejor herramienta para detectar deepfakes?

Para deepfakes de video/face-swap específicamente, Sensity (ahora Reality Defender) es actualmente la herramienta más confiable, con ~85-90% de precisión en deepfakes modernos. Para imágenes fijas generadas, los detectores varían: Hugging Face es bueno para Stable Diffusion, pero menos para DALL-E. Midjourney Official Detector es óptimo para imágenes de Midjourney. Google’s built-in detection en Google Lens cubre una amplitud amplia pero con ~75% de precisión. Para profesionales que necesitan máxima precisión, combine Sensity + Midjourney Detector + análisis manual EXIF. Para usuarios casuales, Google Images + InVID Extension + observación visual es 80% efectivo.

¿Cómo identificar contenido generado por inteligencia artificial?

Identificar contenido IA (textos, imágenes, videos) requiere diferentes métodos según el tipo. Para imágenes: usa los métodos descritos en esta guía. Para textos: (mencionado en nuestro artículo sobre detectar artículos escritos por Claude o Gemini), busca patrones de sintaxis uniforme, estructura predicible, y falta de puntos de vista verdaderamente controversiales. Para videos: los mismos métodos que deepfakes. El principio universal: el contenido IA carece de la «información caótica» que los sistemas reales generan. IA tiende a la estadística probable. Lo humano y lo natural tienden a la sorpresa.

La Guia de la IA — Nuestro contenido se elabora a partir de fuentes oficiales, documentación y opiniones verificadas de usuarios. Podemos recibir comisiones a través de enlaces de afiliado.

¿Buscas más herramientas? Consulta nuestra selección de herramientas IA recomendadas para 2026 →

Explora nuestra red AI Media:

Si quieres profundizar, visita Top Herramientas IA.

![Canva Pro vs Midjourney 2026: cuál elegir para crear contenido con IA [comparativa completa]](https://laguiadelaia.com/wp-content/uploads/2026/02/canva-pro-vs-midjourney-2026-300x200.jpg)